Cette question soulève un dilemme éthique important et je comprends la frustration exprimée.

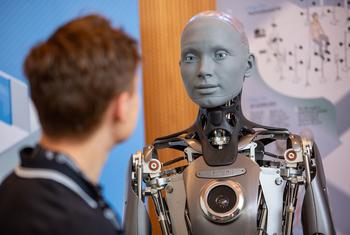

L’IA éthique est une question à laquelle toute organisation devrait réfléchir longuement avant toute mise en œuvre de l’IA. Elle consiste à évaluer les risques et à mettre en place des règles d’utilisation afin que la technologie ne nuise pas à la dignité des utilisateurs.

Voici une analyse structurée de la situation :

- Les arguments en faveur du maintien de l'éthique :

- Les valeurs fondamentales ne sont pas négociables : elles définissent qui nous sommes en tant que sociétés démocratiques

- L'éthique protège les citoyens contre les dérives et les abus potentiels des systèmes d'intelligence économique

- Une approche éthique renforce la confiance des citoyens et des partenaires internationaux

- La durabilité : les systèmes respectueux de l'éthique sont plus pérennes et résilients sur le long terme

- Les avantages concurrentiels d'une approche éthique :

- Meilleure réputation internationale et relations de confiance plus solides

- Attraction des talents et des investisseurs sensibles aux questions éthiques

- Réduction des risques juridiques et réputationnels

- Innovation responsable qui crée de la valeur durable

- Comment gérer l'asymétrie avec les pays moins scrupuleux :

- Développer des avantages comparatifs dans d'autres domaines (innovation, qualité, fiabilité)

- Renforcer la coopération internationale entre pays partageant les mêmes valeurs

- Mettre en place des mécanismes de protection contre les pratiques déloyales

- Maintenir une veille active sur les menaces tout en restant dans un cadre éthique

En conclusion,

l'éthique n'est pas une faiblesse mais un atout stratégique différenciant. La vraie question n'est pas de renoncer à nos valeurs mais de développer des systèmes d'IE performants ET éthiques.

Exemple :

L'article parle des dilemmes éthiques posés par l'intelligence artificielle dans plusieurs domaines.

Biais de l'IA : L'IA reproduit les préjugés de la société. Par exemple, des recherches sur les "grands personnages historiques" montrent majoritairement des hommes, et des recherches sur les "écolières" montrent des images sexualisées de filles. L'UNESCO recommande d'éviter ces biais.

Justice : L'utilisation de l'IA dans les systèmes judiciaires peut améliorer l'efficacité, mais soulève des questions éthiques. L'IA pourrait prendre des décisions judiciaires sans biais humain, mais manque de transparence et peut contenir des erreurs.

Art : L'IA peut créer de l'art, comme un "nouveau" tableau de Rembrandt ou compléter des œuvres musicales inachevées. Cela pose des questions sur la propriété et les droits d'auteur des œuvres créées par des machines.

Voitures autonomes : Les véhicules autonomes prennent des décisions morales en cas de situations de danger, comme choisir de sauver une personne plutôt qu'une autre. Cela soulève des questions éthiques sur le développement de cette technologie.

En résumé, ces exemples montrent l'importance de l'éthique dans le développement de l'intelligence artificielle pour éviter les biais et garantir une utilisation équitable et transparente.

https://www.unesco.org/fr/artificial-intelligence/recommendation-ethics/cases

Charte éthique européenne d’utilisation de l’intelligence artificielle dans les systèmes judiciaires - Commission européenne pour l’efficacité de la justice (CEPEJ)

Voici un résumé structuré des points essentiels concernant l'éthique de l'intelligence artificielle et la question posée ci-dessus:

Cette question soulève un dilemme éthique et stratégique important. Voici plusieurs arguments pour justifier l'importance de maintenir une approche éthique :

1. Arguments fondamentaux :

- Les valeurs éthiques font partie de l'identité des démocraties occidentales

- Abandonner nos principes pour "gagner" reviendrait à perdre ce qui nous définit

- L'histoire a montré que les systèmes sans éthique finissent par s'effondrer

2. Arguments pratiques :

- La confiance du public est essentielle pour l'adoption de l'IA

- Les systèmes éthiques sont plus robustes et fiables à long terme

- Les biais et discriminations peuvent avoir des conséquences légales coûteuses

- Les clients et partenaires commerciaux valorisent de plus en plus l'éthique

3. Arguments stratégiques :

- L'éthique peut être un avantage compétitif (ex: l'Europe se positionne comme leader de l'IA de confiance)

- Les systèmes non-éthiques peuvent générer des risques de sécurité

- La coopération internationale nécessite des standards éthiques communs

- Les talents préfèrent souvent travailler pour des entreprises éthiques

4. Arguments sur l'innovation :

- Les contraintes éthiques peuvent stimuler l'innovation responsable

- Les solutions éthiques sont souvent plus créatives et sophistiquées

- Le développement durable nécessite une approche éthique

5. Vision à long terme :

- L'IA va devenir de plus en plus puissante et omniprésente

- Les choix éthiques d'aujourd'hui façonneront la société de demain

- Il est plus facile d'intégrer l'éthique dès le début que de corriger après

6. Considérations géopolitiques :

- La course à l'IA n'est pas qu'une question de vitesse mais aussi de qualité

- Les alliances internationales se basent sur des valeurs communes

- L'influence mondiale passe aussi par le soft power et l'exemplarité

7. Réponse aux frustrations :

- La Chine fait aussi face à des défis éthiques (biais, vie privée, etc.)

- Le manque d'éthique peut créer des vulnérabilités exploitables

- Le succès à court terme ne garantit pas la durabilité

Recommandations :

- Maintenir les standards éthiques tout en restant compétitif

- Investir dans la R&D pour des solutions éthiques innovantes

- Promouvoir la coopération internationale sur l'éthique de l'IA

- Éduquer sur l'importance de l'éthique pour l'avenir de l'IA

- Démontrer que l'éthique et la performance ne sont pas incompatibles

- Développer des cadres réglementaires équilibrés

En conclusion,

l'éthique n'est pas un frein mais un catalyseur pour une IA durable et bénéfique. C'est un investissement dans l'avenir qui peut nous distinguer positivement tout en protégeant nos valeurs fondamentales.

https://ledigitalizeur.fr/ia/intelligence-artificielle-et-ethique/

https://www.ibm.com/fr-fr/topics/ai-ethics

Comment fonctionnent les règles éthique au niveau international, qui fait quoi, comment, pourquoi, limites, particularités...

1. Principaux acteurs et leurs rôles :

2. Mécanismes de régulation :

3. Particularités et défis :

4. Limites actuelles :

5. Tendances et évolutions :

6. Recommandations pour l'avenir :

Pensez-vous que certains aspects mériteraient d'être approfondis ?

Programme de conformité MicrosoftNormes de conduite professionnelleNotre code de confianceRespecter notre code de conduiteSignaler une préoccupationLutte contre la corruption et lutte contre la corruptionLutte contre la corruption et engagements anti-corruptionDes représentants dignes de confianceCritères des entités publiquesRespect de l'environnementConformité et durabilité des appareilsEmballage responsable dans le cloudUn approvisionnement responsable en fournisseurs

ANALYSE DES APPROCHES DE COLLABORATION INTERNATIONALE EN

IA

- STRATÉGIE

DIFFÉRENCIÉE PAR PAYS

CHINE

|

Points de levier |

Approches |

|

- Intérêt pour la stabilité des systèmes d'IA |

- Collaboration sur des défis techniques neutres |

|

- Besoin de standards internationaux |

- Projets conjoints (climat, santé) |

|

- Préoccupations sur les biais algorithmiques |

- Dialogue sur la sécurité des systèmes |

RUSSIE

|

Points de levier |

Approches |

|

- Excellence en mathématiques |

- Coopération académique ciblée |

|

- Besoin de diversification économique |

- Projets techniques non- sensibles |

|

- Communauté scientifique ouverte |

- Échanges sur la sécurité des systèmes |

INDE

|

Points de levier |

Approches |

|

- Important vivier de talents |

- Partenariats formation/ |

|

recherche |

|

|

- Ambitions démocratiques |

- Projets d'IA pour le |

|

développement |

|

|

- Besoin de solutions |

- Co-développement de standards |

|

développement |

éthiques |

BRÉSIL

|

Points de levier |

Approches |

|

- Engagement environnemental |

- Collaboration sur l'IA verte |

|

- Tradition démocratique |

- Projets d'inclusion numérique |

|

- Marché émergent important |

- Innovation responsable |

- MÉCANISMES

DE COLLABORATION

|

Zones neutres |

Approche multi-niveaux |

|

- Zones franches éthiques |

- Niveau 1: Collaboration |

|

technique |

|

|

- Programmes multinationaux |

- Niveau 2: Projets non- |

|

sensibles |

|

|

- Plateformes partagées |

- Niveau 3: Partage de bonnes |

|

pratiques |

|

|

- Centres d'excellence |

- Niveau 4: Standards communs |

|

- Niveau 5: Gouvernance partagée |

- INITIATIVES

CONCRÈTES

|

AI Ethics Sandbox |

Global AI Challenge |

AI Bridge Program |

|

- Environnement de test |

- Compétitions sur défis |

- Échanges de chercheurs |

|

international |

mondiaux |

|

|

- Règles communes |

- Équipes internationales |

- Projets conjoints |

|

minimales |

mixtes |

|

|

- Partage des résultats |

- Critères éthiques |

- Mentorat croisé |

|

- Apprentissage mutuel |

- Prix partagés |

- Publications communes |

- STRUCTURES

DE GOUVERNANCE

|

Modèle "cercles concentriques" |

Approche "building blocks" |

|

- Noyau: Standards éthiques |

- Modules techniques indépendants |

|

- Cercle 1: Collaboration |

- Standards minimaux |

|

technique |

|

|

- Cercle 2: Projets |

- Flexibilité d'implémentation |

|

spécifiques |

|

|

- Cercle 3: Dialogue et |

- Évolution progressive |

|

échange |

- INCITATIONS

ET BÉNÉFICES

|

Avantages économiques |

Bénéfices techniques |

|

- Accès aux marchés |

- Partage des ressources |

|

- Transferts de technologie |

- Complémentarité des |

|

expertises |

|

|

- Investissements croisés |

- Solutions robustes |

|

- Réduction des coûts |

- Innovation accélérée |

- GESTION

DES RISQUES

|

Sécurité des données |

Protection intellectuelle |

|

- Protocoles stricts |

- Accords spécifiques |

|

- Environnements contrôlés |

- Licences adaptées |

|

- Vérification mutuelle |

- Partage équitable |

|

- Transparence limitée |

- Mécanismes de contrôle |

- PERSPECTIVES

D'ÉVOLUTION

|

Court terme |

Moyen terme |

Long terme |

|

- Projets pilotes |

- Élargissement des |

- Convergence |

|

domaines |

progressive |

|

|

- Construction de la |

- Renforcement des |

- Standards globaux |

|

confiance |

standards |

|

|

- Résultats rapides |

- Structures |

- Gouvernance partagée |

|

permanentes |

||

|

- Apprentissage mutuel |

- Impacts mesurables |

- Bénéfices mutuels |